大模型LLM面试题大全超详细解析26-29题: 《大模型LLM面试题大全超详细解析》系列教程旨在帮助求职者系统掌握大模型相关面试知识。教程涵盖模型原理、训练技巧、应用场……

哈喽!伙伴们,我是小智,你们的AI向导。欢迎来到每日的AI学习时间。今天,我们将一起深入AI的奇妙世界,探索“大模型LLM面试题大全超详细解析26-29题”,并学会本篇文章中所讲的全部知识点。还是那句话“不必远征未知,只需唤醒你的潜能!”跟着小智的步伐,我们终将学有所成,学以致用,并发现自身的更多可能性。话不多说,现在就让我们开始这场激发潜能的AI学习之旅吧。

大模型LLM面试题大全超详细解析26-29题:

《大模型LLM面试题大全超详细解析》系列教程旨在帮助求职者系统掌握大模型相关面试知识。教程涵盖模型原理、训练技巧、应用场景及优化策略等核心内容,结合真实面试题,提供详细解析与实战技巧。无论你是初学者还是进阶者,都能从中获得实用指导,轻松应对大模型领域的面试挑战,提升求职竞争力。

26、在大型语言模型(llm)中使用子词算法(如BPE或WordPiece)的优点是什么?

答案:

A.限制词汇量

B.减少训练数据量C.提高计算效率

答案:A

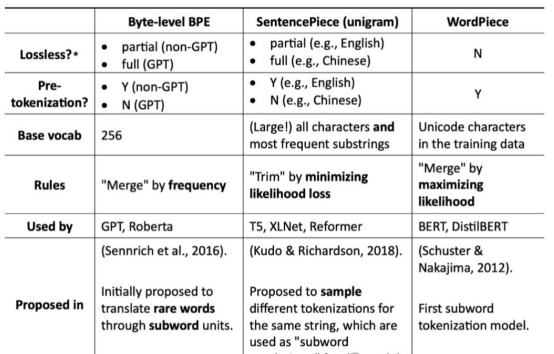

llm处理大量的文本,如果考虑每一个单词,就会导致一个非常大的词表。像字节对编码(BPE)和WordPiece这样的子词算法将单词分解成更小的有意义的单位(子词),然后用作词汇表。这大大减少了词汇量,同时仍然捕获了大多数单词的含义,使模型更有效地训练和使用。

子词算法不直接减少训练数据量。数据大小保持不变。虽然限制词汇表大小可以提高计算效率,但这并不是子词算法的主要目的。它们的主要优点在于用较小的单位集有效地表示较大的词汇表。

27、与Softmax相比,Adaptive Softmax如何提高大型语言模型的速度?

答案:

A.稀疏单词表示

B.Zipf定律

C.预训练嵌入

答案:B

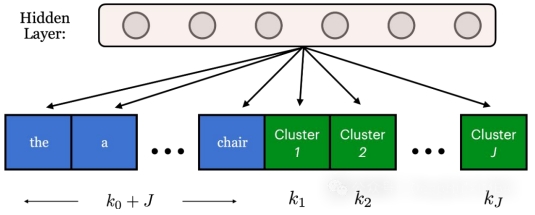

标准Softmax需要对每个单词进行昂贵的计算,Softmax为词表中的每个单词进行大量矩阵计算,导致数十亿次操作,而Adaptive Softmax利用Zipf定律(常用词频繁,罕见词不频繁)按频率对单词进行分组。经常出现的单词在较小的组中得到精确的计算,而罕见的单词被分组在一起以获得更有效的计算。这大大降低了训练大型语言模型的成本。

虽然稀疏表示可以改善内存使用,但它们并不能直接解决Softmax在大型词汇表中的计算瓶颈。预训练嵌入增强了模型性能,但没有解决Softmax计算复杂性的核心问题。

28、可以调整哪些推理配置参数来增加或减少模型输出层中的随机性?

答案:

A.最大新令牌数

B. Top-k

C.Temperature

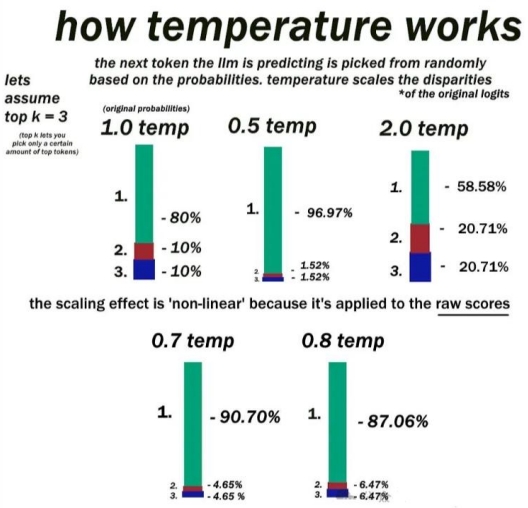

答案:C 在文本生成过程中,大型语言模型(llm)依赖于softmax层来为潜在的下一个单词分配概率。温度Temperature是影响这些概率分布随机性的关键参数。

当温度设置为低时,softmax层根据当前上下文为具有最高可能性的单个单词分配显着更高的概率。更高的温度“软化”了概率分布,使其他不太可能出现的单词更具竞争力。

最大新令牌数仅定义LLM在单个序列中可以生成的最大单词数。top -k采样限制softmax层只考虑下一个预测最可能的前k个单词。

29、当模型不能在单个GPU加载时,什么技术可以跨GPU扩展模型训练?

答案:

A. DDP

B. FSDP

答案:B

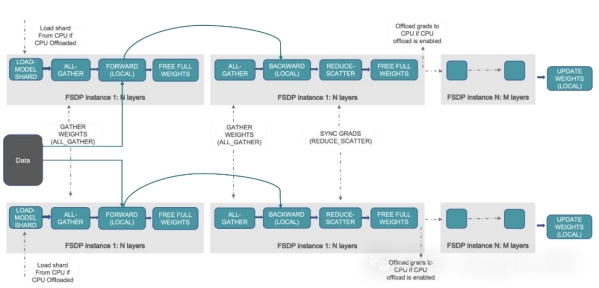

FSDP(Fully Sharded Data Parallel)是一种技术,当模型太大而无法容纳在单个芯片的内存时,它允许跨GPU缩放模型训练。FSDP可以将模型参数,梯度和优化器进行分片操作,并且将状态跨gpu传递,实现高效的训练。

DDP(分布式数据并行)是一种跨多个GPU并行分发数据和处理批量的技术,但它要求模型适合单个GPU,或者更直接的说法是DDP要求单个GPU可以容纳下模型的所有参数。

嘿,伙伴们,今天我们的AI探索之旅已经圆满结束。关于“大模型LLM面试题大全超详细解析26-29题”的内容已经分享给大家了。感谢你们的陪伴,希望这次旅程让你对AI能够更了解、更喜欢。谨记,精准提问是解锁AI潜能的钥匙哦!如果有小伙伴想要了解学习更多的AI知识,请关注我们的官网“AI智研社”,保证让你收获满满呦!

微信扫一扫

微信扫一扫  支付宝扫一扫

支付宝扫一扫

还没有评论呢,快来抢沙发~