大模型LLM面试题大全超详细解析16-20题: 《大模型LLM面试题大全超详细解析》系列教程旨在帮助求职者系统掌握大模型相关面试知识。教程涵盖模型原理、训练技巧、应用场……

哈喽!伙伴们,我是小智,你们的AI向导。欢迎来到每日的AI学习时间。今天,我们将一起深入AI的奇妙世界,探索“大模型LLM面试题大全超详细解析16-20题”,并学会本篇文章中所讲的全部知识点。还是那句话“不必远征未知,只需唤醒你的潜能!”跟着小智的步伐,我们终将学有所成,学以致用,并发现自身的更多可能性。话不多说,现在就让我们开始这场激发潜能的AI学习之旅吧。

大模型LLM面试题大全超详细解析16-20题:

《大模型LLM面试题大全超详细解析》系列教程旨在帮助求职者系统掌握大模型相关面试知识。教程涵盖模型原理、训练技巧、应用场景及优化策略等核心内容,结合真实面试题,提供详细解析与实战技巧。无论你是初学者还是进阶者,都能从中获得实用指导,轻松应对大模型领域的面试挑战,提升求职竞争力。

16、预训练(Pretraining)

答案:

该阶段需要利用海量的训练数据,包括互联网网页、维基百科、书籍、GitHub、论文、问答网站等,构建包含数千亿甚至数万亿单词的具有多样性的内容。利用由数千块高性能GPU 和高速网络组成超级计算机,花费数十天完成深度神经网络参数训练,构建基础语言模型(Base Model)。**基础大模型构建了长文本的建模能力,使得模型具有语言生成能力,根据输入的提示词(Prompt),模型可以生成文本补全句子。也有部分研究人员认为,语言模型建模过程中也隐含的构建了包括事实性知识

(Factual Knowledge)和常识知识(Commonsense)在内的世界知识(World Knowledge)。**根据文献[1] 介绍,GPT-3 完成一次训练的总计算量是3640PFlops,按照NVIDIA A100 80G 和平均利用率达到 50% 计算,需要花费近一个月时间使用1000 块GPU 完成。

由于GPT-3 训练采用了NVIDIA V100 32G,其实际计算成本远高于上述计算。文献[2] 介绍了参数量同样是1750 亿的OPT 模型,该模型训练使用了992 块NVIDIA A100 80G,整体训练时间将近2 个月。BLOOM[3] 模型的参数量也是1750 亿,该模型训练一共花费3.5 个月,使用包含384 块NVIDIA A100 80G GPU 集群完成。可以看到大规模语言模型的训练需要花费大量的计算资源和时间。

包括LLaMA 系列、Falcon 系列、百川(Baichuan)系列等在模型都属于此阶段。由于训练过程需要消耗大量的计算资源,并很容易受到超参数影响,如何能够提升分布式计算效率并使得模型训练稳定收敛是本阶段的重点研究内容。

17、有监督微调(Supervised Finetuning)

答案:

利用这些有监督数据,使用与预训练阶段相同的语言模型训练算法,在基础语言模型基础上再进行训练,从而得到有监督微调模型(SFT模型)。经过训练的SFT 模型具备了初步的指令理解能力和上下文理解能力,能够完成开放领域问题、阅读理解、翻译、生成代码等能力,也具备了一定的对未知任务的泛化能力。由于有监督微调阶段的所需的训练语料数量较少,SFT 模型的训练过程并不需要消耗非常大量的计算。根据模型的大小和训练数据量,通常需要数十块GPU,花费数天时间完成训练。SFT 模型具备了初步的任务完成能力,可以开放给用户使用,很多类ChatGPT的模型都属于该类型,包括:Alpaca[4]、Vicuna[5]、MOSS、ChatGLM-6B 等。很多这类模型效果也非常好,甚至在一些评测中达到了ChatGPT 的 90% 的效果[4, 5]。当前的一些研究表明有监督微调阶段数据选择对SFT 模型效果有非常大的影响[6],因此如何构造少量并且高质量的训练数据是本阶段有监督微调阶段的研究重点

18、奖励建模(Reward Modeling)

答案:

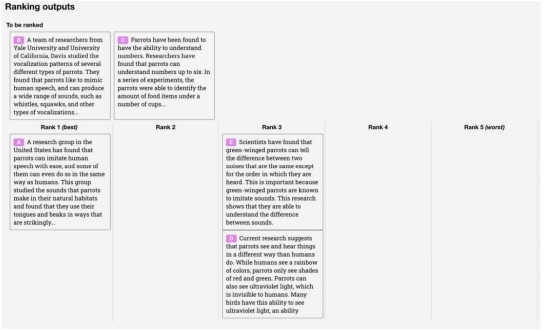

该阶段目标是构建一个文本质量对比模型,对于同一个提示词,SFT 模型给出的多个不同输出结果的质量进行排序。奖励模型(RM 模型)可以通过二分类模型,对输入的两个结果之间的优劣进行判断。RM 模型与基础语言模型和SFT 模型不同,RM 模型本身并不能单独提供给用户使用。奖励模型的训练通常和SFT 模型一样,使用数十块GPU,通过几天时间完成训练。由于RM 模型的准确率对于强化学习阶段的效果有着至关重要的影响,因此对于该模型的训练通常需要大规模的训练数据。AndrejKarpathy 在报告中指出,该部分需要百万量级的对比数据标注,而且其中很多标注需要花费非常长的时间才能完成。下图2给出了InstructGPT 系统中奖励模型训练样本标注示例[7]。可以看到,示例中文本表达都较为流畅,标注其质量排序需要制定非常详细的规范,标注人员也需要非常认真的对标规范内容进行标注,需要消耗大量的人力,同时如何保持众包标注人员之间的一致性,也是奖励建模阶段需要解决的难点问题之一。此外奖励模型的泛化能力边界也在本阶段需要重点研究的另一个问题。如果RM模型的目标是针对所有提示词系统所生成输出都能够高质量的进行判断,该问题所面临的难度在某种程度上与文本生成等价,因此如何限定RM 模型应用的泛化边界也是本阶段难点问题。

19、强化学习(Reinforcement Learning)

答案:

该阶段根据数十万用户给出的提示词,利用在前一阶段训练的RM 模型,给出SFT 模型对用户提示词补全结果的质量评估,并与语言模型建模目标综合得到更好的效果。该阶段所使用的提示词数量与有监督微调阶段类似,数量在十万量级,并且不需要人工提前给出该提示词所对应的理想回复。使用强化学习,在SFT 模型基础上调整参数,使得最终生成的文本可以获得更高的奖励(Reward)。该阶段所需要的计算量相较预训练阶段也少很多,通常也仅需要数十块GPU,经过数天时间的即可完成训练。文献[7] 给出了强化学习和有监督微调的对比,在模型参数量相同的情况下,强化学习可以得到相较于有监督微调好得多的效果。关于为什么强化学习相比有监督微调可以得到更好结果的问题,截止到2023年9 月也还没有完整和得到普遍共识的解释。此外,Andrej Karpathy 也指出强化学习也并不是没有问题的,它会使得基础模型的熵降低,从而减少了模型输出的多样性。** 在经过强化学习方法训练完成后的RL 模型,就是最终提供给用户使用具有理解用户指令和上下文的类ChatGPT 系统。**由于强化学习方法稳定性不高,并且超参数众多,使得模型收敛难度大,再叠加RM 模型的准确率问题,使得在大 规模语言模型如何能够有效应用强化学习非常困难。

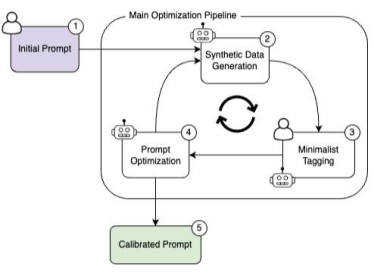

20、哪种技术有助于减轻基于提示的学习中的偏见?

答案:

A.微调Fine-tuning

B.数据增强Data augmentation

C.提示校准Prompt calibration

D.梯度裁剪Gradient clipping

答案:C

提示校准包括调整提示,尽量减少产生的输出中的偏差。微调修改模型本身,而数据增强扩展训练数据。

梯度裁剪防止在训练期间爆炸梯度。

嘿,伙伴们,今天我们的AI探索之旅已经圆满结束。关于“大模型LLM面试题大全超详细解析16-20题”的内容已经分享给大家了。感谢你们的陪伴,希望这次旅程让你对AI能够更了解、更喜欢。谨记,精准提问是解锁AI潜能的钥匙哦!如果有小伙伴想要了解学习更多的AI知识,请关注我们的官网“AI智研社”,保证让你收获满满呦!

微信扫一扫

微信扫一扫  支付宝扫一扫

支付宝扫一扫

还没有评论呢,快来抢沙发~