AI大模型基础环境搭建: 搭建 大模型基础环境 大模型基础环境通常会依赖以下package: PyTorch:PyTorch 是一个用于深度学习的开源库,由 Facebook Al Research 开发。……

哈喽!伙伴们,我是小智,你们的AI向导。欢迎来到每日的AI学习时间。今天,我们将一起深入AI的奇妙世界,探索“AI大模型基础环境搭建”,并学会本篇文章中所讲的全部知识点。还是那句话“不必远征未知,只需唤醒你的潜能!”跟着小智的步伐,我们终将学有所成,学以致用,并发现自身的更多可能性。话不多说,现在就让我们开始这场激发潜能的AI学习之旅吧。

AI大模型基础环境搭建:

搭建

大模型基础环境

大模型基础环境通常会依赖以下package:

PyTorch:PyTorch 是一个用于深度学习的开源库,由 Facebook Al Research 开发。PyTorch 广泛用于自然语言处理、计算机视觉和语音识别等领域。

torchvision:torchvision是一个用于计算机视觉任务的库,提供了图像和视频处理的各种功能。torchvision基于PyTorch构建,方便在PyTorch项目中使用。

torchaudio:torchaudio 是一个用于音频处理的库,提供了对音频信号进行处理的函数和预训练模型。。torchaudio 也基于PyTorch 构建,可以在 PyTorch 项目中轻松集成。

允许开发人员编写在GPU上运行的代码,从而加快计算速度。PyTorch 等深度学习库通常使用 CUDA 来进行GPU 加速。

结合所选取的大模型,参考 https://pytorch.org/get-started/previous-versions/选取合适的环境 package 组合。

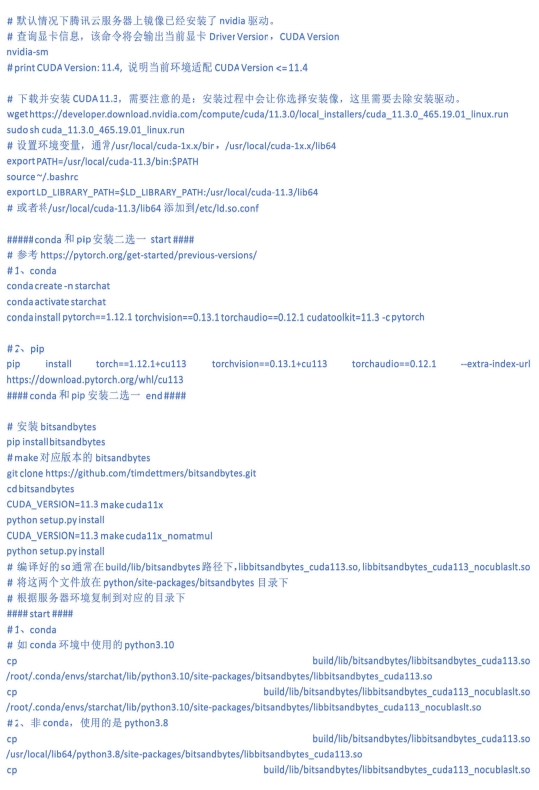

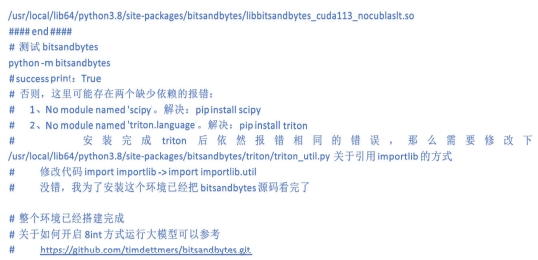

Bitsandbytes:提供高效的位操作和字节操作功能。它可以帮助开发人员更轻松地处理二进制数据和进行位级操作。

很多情况大模型所需要的服务器配额我们是无法满足的,这个时候需要bitsandbytes降低推理精度以达到降低所需显存配额的目的。

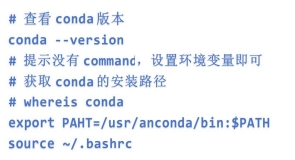

conda安装

如果确保机器只归你一个人使用可以不用安装

下载并安装 anaconda,选择你需要的版本即可上机安装:https://repo.anaconda.com/archive/以 Tlinux为例:下载 Anaconda3-2023.07-2-Linux-x86_64.sh 并执行,等待安装完成。

bashAnaconda3-2023.07-2-Linux-x86_64.sh

是否安装成功

conda常用命令

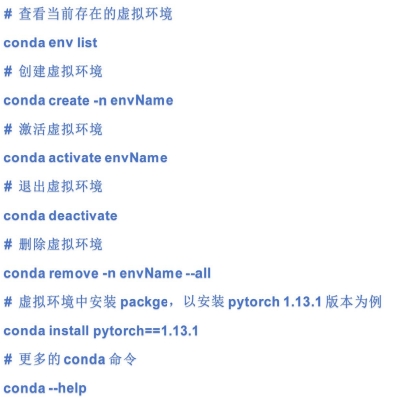

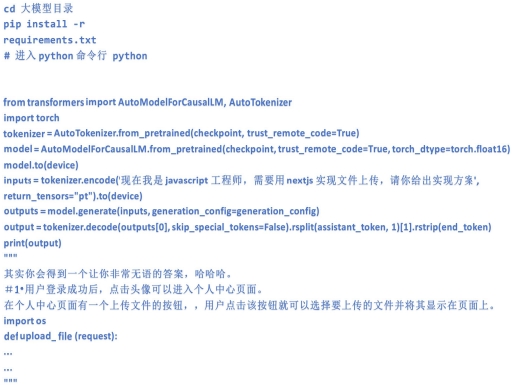

demo环境搭建

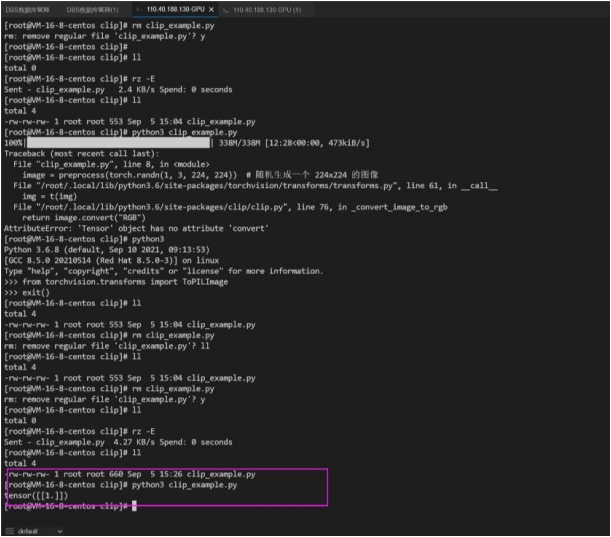

以cuda11.3为例搭建大模型运行环境。

说明,cuda11.3 较为典型,在 bitsandbytes 中没有预先编译适配 11.3 的 so。所以 11.3 的整个环境搭建具备完整环境搭建流程,适配所有cuda版本环境搭建。

至此 demo 中的大模型环境已经搭建完成。大家可以在 huggingface 或者 百度飞浆 中获取自己想要的AI模型来愉快的玩耍。

关于该git项目需要注意的一些点

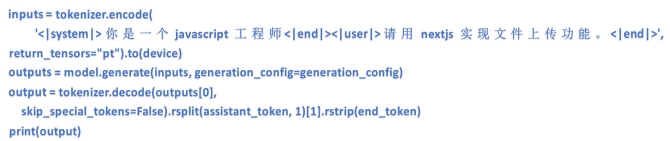

遇到这种情况不要慌,并不是大模型的能力有问题。这个引入一个初学大模型的概念 prompt 就是所谓的工程提示,如果我们给出合理的提示功能标签,那么大模型可以更好的识别问题。

常见的LLM通用提示标签有

<|assistant|>:ai回答

那么以上问题,通过合理的 prompt 之后是:

inputs 这里应该是:

前后端封装

前后端封装相对比较简单,主要干的就是:fastapi封装应用接口、大模型输出结果用接口返回给前端页面、前端页面收集到的问题和参数通过接口调用大模型。代码已传。

有点开发经验的同学应该能看懂,该文主要是分享记录大模型基础环境的搭建,就不赘述这部分内容啦。

实现效果截图和一点后续的废话:

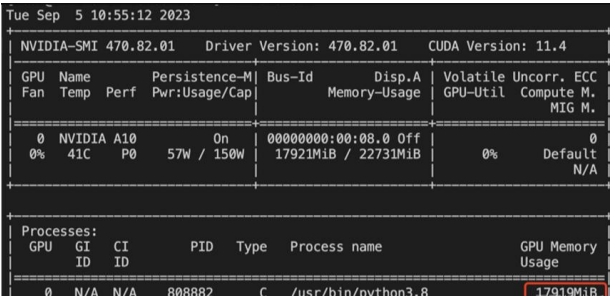

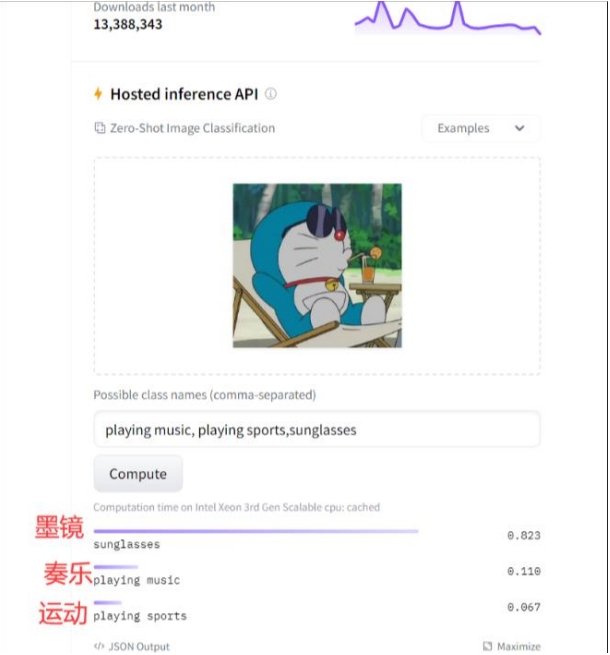

本人手里也没有合适跑 AI模型的机器,是在腾讯云上了一个新用户的福利,几十块租了一星期练手。后面机器到期了所以没法发链接给读者亲身体验,不过一些步骤有截图记录,同时项目上传了github 仓库,会提供 git 地址。跑了starchat(语言模型)和clip(图像识别)两个模型。

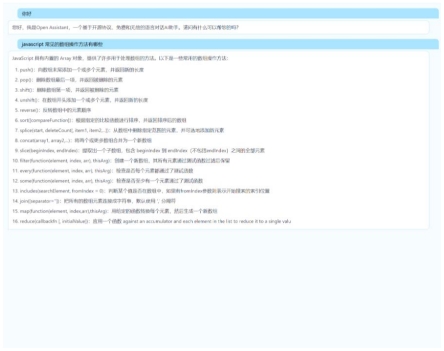

套壳后的startchat,如图:(哈哈)

看一下运行时的显存(跑起来差不多用了18个G)

这个是完整页面,前端页面有一些可调参数

clip 运行的情况(clip 相对没 starchat 这么吃显存)

嘿,伙伴们,今天我们的AI探索之旅已经圆满结束。关于“AI大模型基础环境搭建”的内容已经分享给大家了。感谢你们的陪伴,希望这次旅程让你对AI能够更了解、更喜欢。谨记,精准提问是解锁AI潜能的钥匙哦!如果有小伙伴想要了解学习更多的AI知识,请关注我们的官网“AI智研社”,保证让你收获满满呦!

微信扫一扫

微信扫一扫  支付宝扫一扫

支付宝扫一扫

还没有评论呢,快来抢沙发~